音楽に映像がつくと、「体験」になる

曲を作って、配信する。

それだけでも十分すごいことだと思う。

でも映像がつくと、音楽の受け取り方が変わる。

聴くだけだった曲が、「観る」ものになる。

自分の場合、AI時代に音楽活動を始めた理由でも書いた通り、楽器は弾けないしDAWの画面を見ても挫折するところからスタートした。

でもMidjourneyを使うようになって、頭の中にあった「こういう映像で曲を聴きたい」というイメージを形にできるようになった。

この記事では、MidjourneyでMVの世界観を作る方法を、自分がStreet Festival SymphonyのMusic Filmを制作した経験をもとに、プロンプト実例付きで解説する。

なぜMidjourneyなのか

AI画像生成ツールは山ほどある。

DALL-E、Stable Diffusion、Flux、Firefly。

それぞれ強みがあるし、用途次第では他のツールのほうが向いている場面もある。

それでもMV制作でMidjourneyを選んでいる理由は、大きく3つ。

1. 「映画っぽさ」が段違い

Midjourneyは何もしなくてもシネマティックな画が出てくる。

照明の当て方、被写界深度、色のグラデーション。

映像に使う素材として、生成した時点である程度のクオリティが担保される。

2. スタイルの一貫性を保ちやすい

`–sref`(スタイルリファレンス)や`–cref`(キャラクターリファレンス)の存在が大きい。

MVでは複数のシーンにわたって世界観を統一する必要がある。

Midjourneyはそれが得意。

3. V7 + V1ビデオモデルの連携

2025年6月にMidjourneyのV1ビデオモデルがリリースされた。

生成した画像をそのまま「Animate」ボタンで5秒の動画にでき、最大21秒まで延長できる。

つまり画像生成から動画化までMidjourney内で完結する道が開けた。

なお2026年3月にはV8 Alphaプレビューも始まっており、画像生成側の進化もまだまだ止まらない。

他ツールが悪いわけじゃない。

ただ、MVの世界観構築という用途に限れば、Midjourneyが一歩リードしていると感じている。

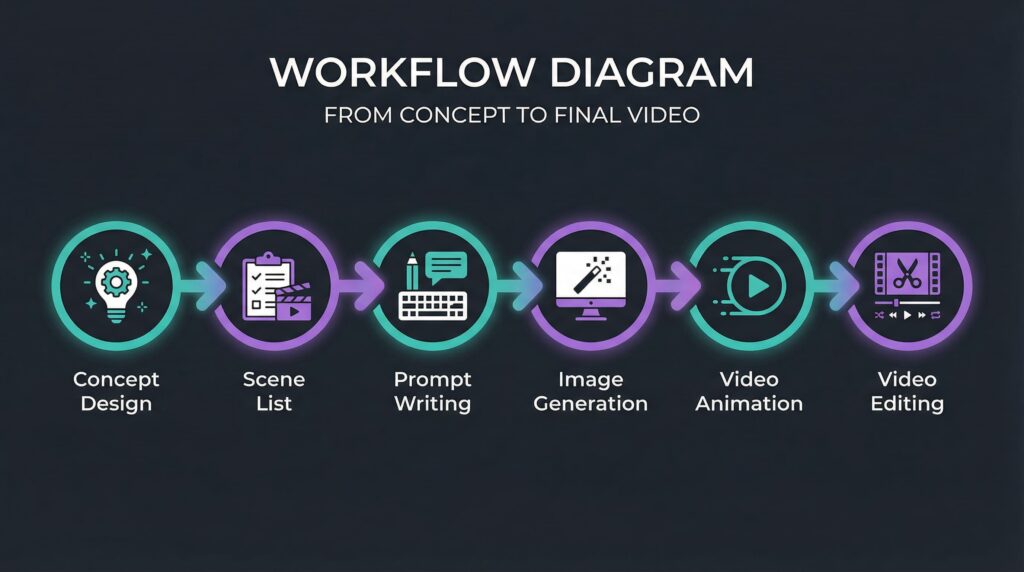

MV制作の全体フロー

いきなりプロンプトを書き始めると迷走する。

全体の流れを先に決めておくのが重要。

1. コンセプト設計

曲の世界観、色のトーン、ビジュアルキーワードを決める

2. シーンリスト作成

曲の構成(イントロ→Aメロ→サビ…)に合わせて

必要なシーンをリストアップ

3. プロンプト設計

各シーンのプロンプトを書く。

カラーパレットとスタイルキーワードは統一

4. Midjourneyで画像生成

各シーンを生成。気に入ったものをセレクト

5. 動画化

V1ビデオモデルでアニメーション化、

またはKling / HailuoAI等で動きをつける

6. 映像編集

DaVinci ResolveやCapCutで曲と映像を同期この流れさえ守れば、初めてでもそれなりに形になる。

大事なのは「1. コンセプト設計」を飛ばさないこと。

ここがブレると、後から全部作り直しになる。

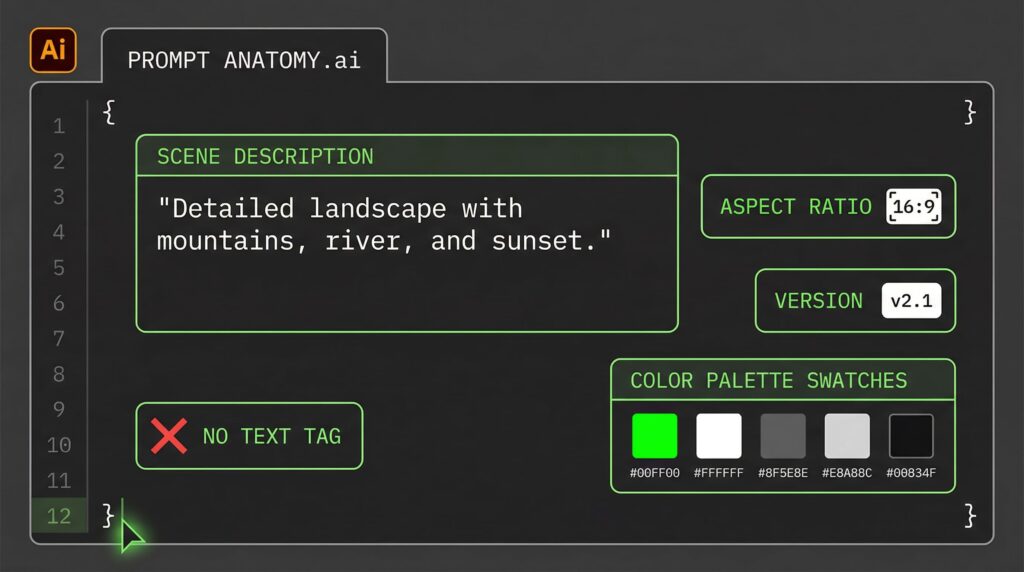

プロンプト設計の基本ルール

MVに使う画像を生成するとき、押さえておくべきポイントがある。

AI動画のプロンプト設計術でも動画生成向けのテクニックを詳しく解説しているので、合わせて読むとプロンプトの精度がさらに上がる。

–ar 16:9 は必須

MVの画像は映像に使う。

だからアスペクト比は`–ar 16:9`一択。

デフォルトの1:1で生成すると、あとから切り抜いたときに構図が崩れる。

最初から16:9で構図を決めておく。

サムネイルやジャケット用に`–ar 1:1`を使うことはあるけど、映像素材は必ず16:9で統一。

–v 7 を使う(2026年3月時点)

Midjourney V7は2025年4月にアルファ版がリリースされ、

6月にデフォルトになった。

V6と比べてテキストプロンプトの理解度が上がり、テクスチャの質感、手や体の描写精度が改善している。

アーキテクチャ自体がゼロからの再構築で、CEO David Holzが「totally different architecture」と表現したほどの大型アップデートだ。

V7ではパーソナライゼーションがデフォルトでオンになっている。

自分の好みを学習してくれるので、使い込むほどスタイルが定まる。

これはMV制作ではかなり有利に働く。

ドラフトモードも便利。

通常の半額のコストで10倍速く生成できるから、アイデア出しの段階ではドラフトモードでバンバン回して、決まったら通常モードで高品質版を生成するワークフローが使える。

なお、2026年3月17日にV8 Alphaがalpha.midjourney.comでプレビュー開始している。

V8は過去最速の生成速度(V7の4〜5倍速)を謳っているが、まだメインサイトやDiscordでは使えない。

安定版を待ちたいなら当面はV7で問題ない。

no text は入れておく

Midjourneyは勝手にテキストを画像に入れてくることがある。

MVの素材にランダムな英語が入ると台無しなので、プロンプトの最後に`–no text, words, letters, typography`を足しておく。

V7ではテキスト生成精度が上がっているぶん、意図しないテキストが入るリスクも上がっている。

カラーパレットをプロンプトに含める

これが世界観統一の要。

曲ごとにカラーパレットを3〜5色決めて、それを毎回プロンプトに含める。

たとえば自分のシリーズでは:

- 黒(背景・夜)

- 赤(提灯・祭り)

- 金(和のアクセント)

- ネオンピンク(サイバーパンク要素)

この4色をベースに全シーンを統一している。

プロンプトに`black, red and gold color palette with neon pink accents`のように色情報を入れるだけで、シーン間の統一感が格段に上がる。

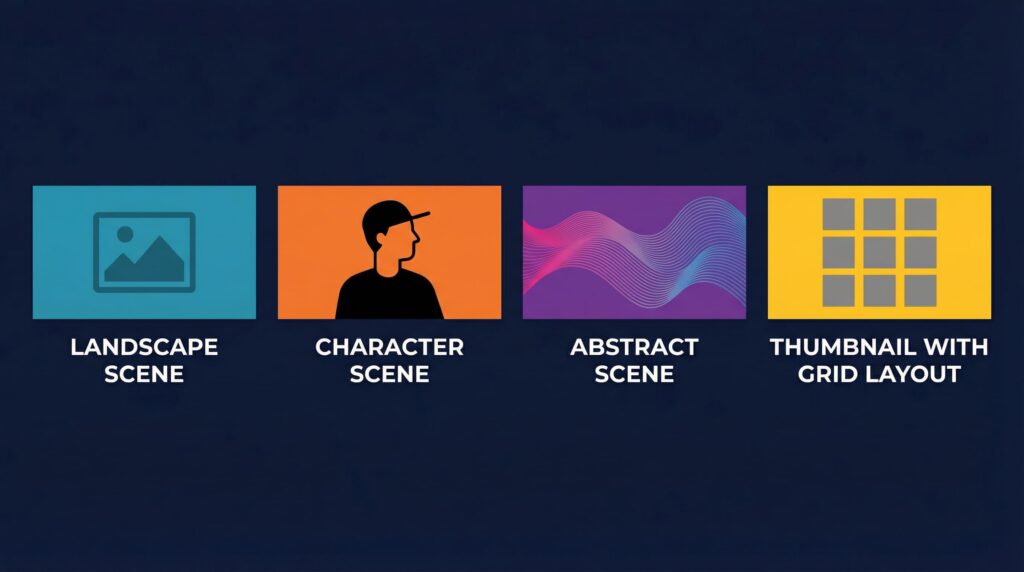

シーン別プロンプトの書き方(実例付き)

ここからは実際のプロンプト例。

すべてMV用に`–ar 16:9`を付けて書いている。

風景・環境シーン

曲のイントロやブリッジに使うワイドショット。場の雰囲気を伝えるためのシーン。

Cinematic wide shot of a Japanese festival street at night,

paper lanterns glowing warm orange, neon lights reflecting

on wet cobblestone, fog and rain, dramatic lighting,

no text --ar 16:9 --v 7ポイントは`cinematic wide shot`で画角を指定していること。

`dramatic lighting`や`fog and rain`で雰囲気を足す。MVでは「ちょっと盛りすぎかな」くらいがちょうどいい。

キャラクター・人物シーン

Aメロやサビで使う、メインビジュアル的なカット。

A mysterious samurai standing in rain at a neon-lit shrine

entrance, cyberpunk Edo period aesthetic, dramatic side

lighting, cinematic composition, no text --ar 16:9 --v 7`cinematic composition`を入れると、映画のワンシーンのような構図になりやすい。

人物の描写は具体的に書くほど意図通りになる。

「mysterious samurai」のように雰囲気を示す形容詞を付けるのがコツ。

抽象・感情表現シーン

間奏やアウトロで使う、具体的なモチーフを持たないシーン。

感情や空気感を映像化する。

Abstract visualization of heartbreak and acceptance,

cherry blossom petals dissolving into digital particles,

warm to cool color gradient, ethereal atmosphere,

no text --ar 16:9 --v 7`abstract visualization of [感情]`というフォーマットが使いやすい。

感情をそのまま書いて、それを象徴するモチーフ(ここでは桜の花びら→デジタルパーティクル)を添える。

色のグラデーション指定(`warm to cool`)も効果的。

サムネイル / ジャケット

YouTubeサムネイルやアルバムジャケット用。ここでは`–niji 7`を使う(後述)。

Street fashion illustration style, a figure in black kimono

with modern headphones standing at festival entrance,

bold red and gold color scheme, stylized and bold,

no text --ar 16:9 --niji 7サムネイルは「パッと見て世界観が伝わる」ことが最優先。

だからイラスト的なスタイルのほうがむしろ映える場面が多い。

niji 7の使い分け

Midjourneyには通常モデル(–v 7)のほかに、アニメ・イラスト特化の`–niji`モデルがある。

2026年1月にniji 7がリリースされた。

niji 7が向いている場面

- サムネイル / ジャケット: フラットでボールドなイラストは目を引く

- アニメ風MV: 全編イラストスタイルで統一したいとき

- SNS投稿用のビジュアル: 写実よりもスタイライズドなほうが映える

niji 7の特徴

niji 7はniji 6からの大幅アップデートで、ライン(輪郭線)がシャープになり、出力がクリーンになった。

デフォルトのスタイルがフラットで、イラストレーション寄り。

プロンプトへの忠実度もV7より高い印象がある。

自分の場合、`street fashion illustration style`をコアキーワードにして、niji 7(当時はniji 6)でイラスト風ビジュアルを量産してみたりした。

映像本体はV7でシネマティックに、サムネイルはniji 7でイラスト風に、という使い分けが気に入っている。

使い分けの判断基準

| 用途 | モデル | 理由 |

|---|---|---|

| 映像素材(シネマティック) | --v 7 | リアルな質感・照明が必要 |

| サムネイル・ジャケット | --niji 7 | 目を引くフラットなスタイル |

| アニメ風MV全体 | --niji 7 | 全体のトーンを統一 |

| 実写風MV | --v 7 | 写実性重視 |

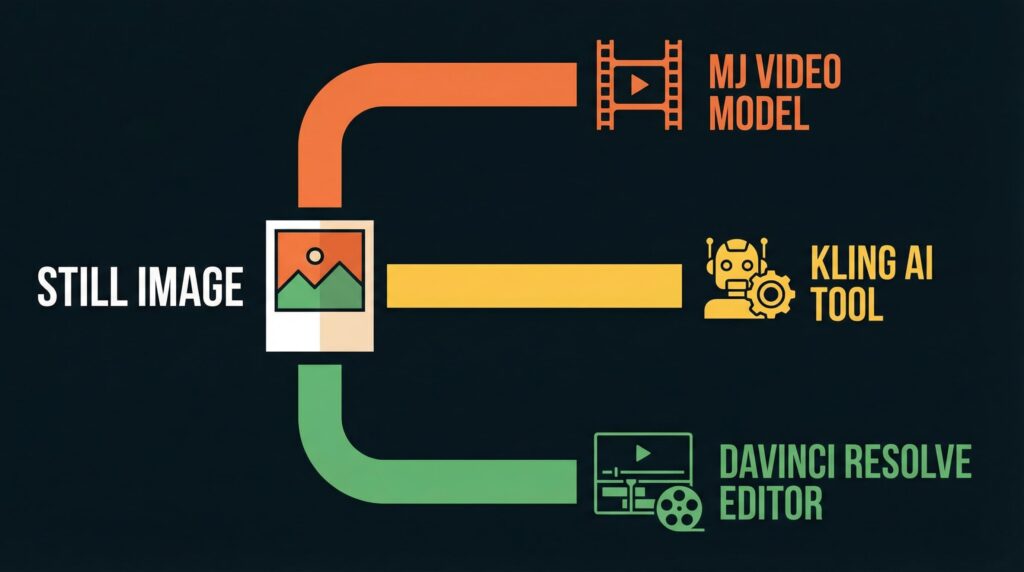

生成画像から映像にする方法

Midjourneyで画像を作った。ここからどう映像にするか。

方法は大きく3つある。

詳しくは画像から動画をAIで作る方法で網羅的に解説しているので、ここでは概要を押さえておく。

1. MidjourneyのV1ビデオモデル

生成した画像の下に「Animate」ボタンが表示される。

押すだけで5秒の動画が4バリエーション同時に生成される。

- Automatic: AIが勝手に動き方を決める。とりあえず試したいときに

- Manual: 動き方を自分で指定できる。「カメラがゆっくりズームイン」とか

- Low Motion / High Motion: 動きの激しさを調整

- Extend: 5秒の動画を最大21秒まで延長

手軽だけど、現時点では480pで画質が粗い。

あくまで「動きの確認」や「ラフ映像」として使って、本番素材は別ツールで作るのが現実的。

2. Kling AI / HailuoAI

画像を元に高品質な動画を生成するツール。

Kling 3.0はネイティブ4K出力に対応していて、物理演算ベースの自然な動きが出せる。

Motion Brush機能で特定オブジェクトだけ動かすような細かい制御も可能になった。

カメラワークや動きの強さも細かく指定できる。

HailuoAI(MiniMax 2.3)はもう少しカジュアル。

速度重視で、ラフな動画をサクッと作りたいときに向いている。

2.3ではアニメスタイルのフレーム一貫性が大幅改善されたので、イラスト風MVとの相性も良い。

自分はStreet Festival SymphonyのMusic Filmで、Midjourneyで生成した画像をKlingとHigsFieldに入れてアニメーション化した。

提灯が風に揺れるとか、雨粒が路面に落ちるとか、そういう「微細な動き」を足すのにAI動画生成は最高に相性がいい。

3. DaVinci Resolve(映像編集)

最終的な映像編集はDaVinci Resolveで行う。無料版でも十分すぎるほど高機能。

AI音楽をDAWで仕上げる方法でDAW側の仕上げについて書いたけど、映像側も同様に「仕上げ」が仕上がりを左右する。

- 生成した画像・動画を並べる

- 曲のビートに合わせてカット切り替え

- ズーム、パン、フェードなどのモーションを追加

- カラーグレーディングで最終的なトーン調整

CapCutでもいいけど、DaVinci Resolveのほうがカラーグレーディングの自由度が高い。

MVは色味が命なので、ここは妥協しないほうがいい。

世界観を統一する5つのコツ

バラバラのシーンを「ひとつのMV」にするための具体的な方法。

1. カラーパレットを固定する

前述の通り、3〜5色のパレットを決めてすべてのプロンプトに含める。

自分の場合は「黒・赤・金・ネオンピンク」。

これだけで全シーンに統一感が出る。

2. スタイルキーワードを統一する

`cinematic`, `dramatic lighting`, `cyberpunk Edo period`のように、毎回使う形容詞を決めておく。

プロンプトのテンプレートを作っておくのがおすすめ。

[シーン描写], [カラーパレット], [スタイルキーワード],

no text --ar 16:9 --v 73. –sref でスタイルリファレンスを使う

気に入った画像が出たら、そのURLを`–sref`で指定することで、以降の生成でスタイルを統一できる。

これはMV制作では必須テクニック。

4. ビジュアルモチーフを繰り返す

Neo Edo Festivalでは「提灯」「神社」「祭り」「雨」「霧」「ネオン」をビジュアルモチーフとして繰り返し使っている。

曲が変わっても、これらのモチーフが共通しているから同じ世界の話だと伝わる。

5. 照明の方向を揃える

意外と見落とされるポイント。サイドライティングで統一するとか、バックライト中心にするとか、光の方向を決めておくと、シーンが切り替わっても違和感が少ない。

実際のワークフロー:Street Festival Symphonyの場合

具体的にどう作ったか、Street Festival Symphonyを例に振り返ってみる。

- コンセプト: 「江戸の祭りとサイバーパンクが融合した夜の街」

- カラーパレット: 黒・赤・金・ネオンピンク

- モチーフ: 提灯、神社、屋台、雨、霧、ネオンサイン

- 生成: V6(当時)で約50枚生成、うち12枚をセレクト

- 動画化: HigsFieldとKlingでアニメーション化

- 編集: DaVinci Resolveで曲に同期、カラーグレーディング

このとき学んだのは、「多めに生成して厳選する」のが圧倒的に効率がいいということ。

1シーンにつき4〜5パターン生成して、一番いいものを選ぶ。

最初から完璧を目指してプロンプトを練り続けるより、ある程度書いたら回して選ぶほうがいい結果になる。

まとめ:映像は「もうひとつの楽器」

MidjourneyでMVの世界観を作る方法をまとめてきた。

ポイントを整理すると:

- アスペクト比は16:9固定、映像素材は例外なし

- カラーパレットとスタイルキーワードを全プロンプトで統一する

- V7でシネマティック、niji 7でイラスト風と使い分ける

- V1ビデオモデルで手軽にアニメーション確認、本番はKling等で

- DaVinci Resolveで最終編集、カラーグレーディングは妥協しない

- 多めに生成して厳選するのがワークフローの肝

歌詞からAI作曲する方法やSuno AI完全ガイドで解説したように音楽制作のハードルが下がったのと同じ構造で、映像も「試せる」時代になっている。

AI音楽にオリジナリティは宿るのかで書いた通り、AIが生成したものをそのまま出すだけでは表現にならない。

でも「自分の頭の中にある世界観を、AIの力を借りて可視化する」というアプローチなら、それはもう立派なクリエイティブだと思っている。

映像は、音楽にとって「もうひとつの楽器」みたいなもの。

弾けなくても、Midjourneyがある。