AIで曲が作れるようになった。

じゃあ次は映像だ。

自分はDJ Albatross名義で音楽をやっていて、ファーストアルバム「Street Festival Symphony」のMVも全部AIで作った。

楽器は弾けない。

映像の専門教育も受けていない。

それでもMVが完成して、YouTubeに公開できている。

使ったのはMidjourneyで画像生成、Klingで動画化、DaVinci Resolveで編集。

この3つだけ。

この記事では「画像から動画をAIで作る」ワークフローを、ツール選びから書き出しまで全部書く。

比較記事だけ読んでも作れない。

実際に手を動かした人間のフローを、そのまま渡す。

画像から動画をAIで作る時代が来た

「おすすめ○選」では作れない——実制作ワークフローが必要な理由

「画像から動画 AI」で検索すると、ツール比較記事がずらっと出てくる。

「おすすめ7選」「無料で使える5つ」みたいなやつ。

読んでみる。

ふーん、色々あるんだな。

で、閉じる。

作れない。

ツールを知っただけでは。

MV制作に限らず、AI動画生成は「ツール選び」と「実際の制作」の間にけっこう溝がある。

どの画像を入れるか、プロンプトをどう書くか、生成された動画をどう繋げるか、音楽とどうシンクさせるか。

比較記事にはそこが書いてない。

だからこの記事では、比較表も出すけど、本題は「実際にMVを1本完成させるまでの全手順」だ。

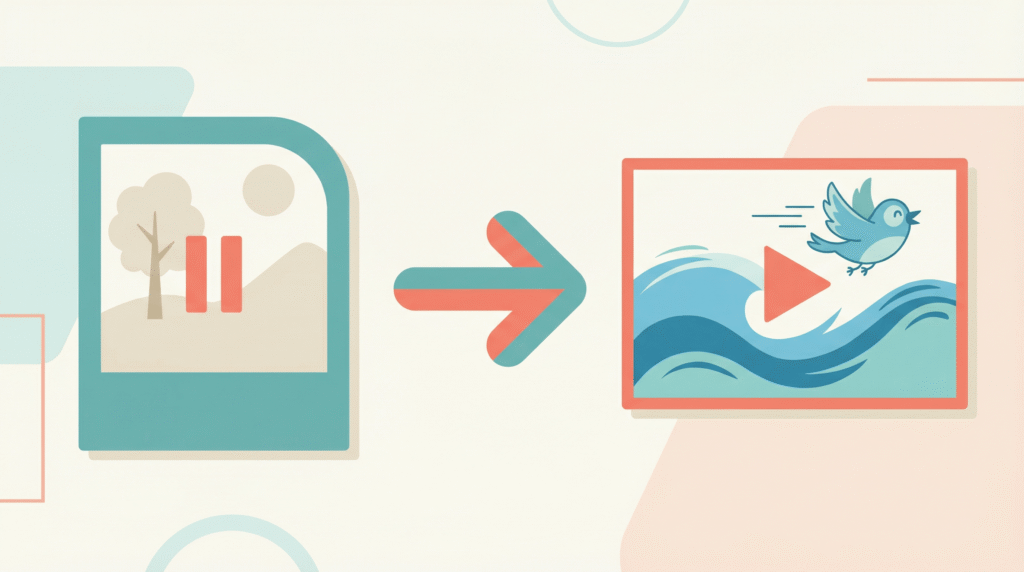

この記事で完成するもの:ジャケット画像→MV映像

最終的なアウトプットはこう。

- 入力: Midjourneyで生成したジャケット画像+カット画像(5〜15枚)

- 処理: 各画像をAI動画化(5〜10秒/カット)→ 編集ソフトで繋ぐ

- 出力: 3〜5分のMV映像(YouTube公開可能品質)

楽曲はすでにある前提で進める。

まだ曲がない人は先にSunoで曲を作る完全ガイドを読んでほしい。

画像から動画AIツール比較|2026年3月版

主要7ツールの料金・品質・特徴まとめ

2026年3月時点で、画像→動画生成に対応している主要ツールを比較する。

実際に触ったものも含めて整理した。

| ツール | バージョン | 料金 | 画像→動画の特徴 | MV向き度 |

|---|---|---|---|---|

| Kling AI | 3.0 | 無料枠あり / Starter $10/月 | Framesモード(忠実)/ Elementsモード(自由)。4K対応 | ★★★ |

| Veo 3.1 (Google) | 3.1 | Google AI Pro $19.99/月。Flow無料枠 | 真4K/60fps。4枚参照画像対応。音声生成対応 | ★★★ |

| Sora 2 (OpenAI) | Sora 2 | ChatGPT Plus $20/月に含む(月50本480p) | 最大1080p/20秒。音声生成対応 | ★★ |

| Runway | Gen-4.5 | Standard $12/月 / Pro $28/月 | キャラクター一貫性に強い。4K対応。25cr/秒と高コスト | ★★ |

| Midjourney | V1 Video | 既存サブスク($10/月〜)内。画像の8倍コスト | Animateボタンで直接動画化。5〜20秒。音声非対応 | ★★ |

| Hailuo (MiniMax) | 2.3 | Standard $9.99/月 | アニメ・イラスト系に強い。バッチ50%コスト削減 | ★★ |

| HigsField | 2026版 | Basic $9/月〜 | マルチモデル統合(Sora 2/Kling/Veo等15+モデル) | ★★★ |

数字だけ並べても判断しづらいと思うので、ポイントを絞る。

MV制作に向いているツールはどれか

結論から言うと、MV制作ならKling AIが現時点の最適解。

理由は3つ。

1. Framesモードの存在

画像の構図や色味をかなり忠実に保ったまま動画化してくれる。

MVではジャケット画像の世界観を壊したくないので、これが決定的にでかい。

Elementsモードに切り替えれば動きの自由度も上げられる。

使い分けができるのが強い。

2. コスパ

Starter $10/月で十分な枚数を生成できる。

Runwayの25cr/秒に比べると、同じ予算で3〜4倍の動画が作れる感覚。

MV1本で30〜50回の生成ガチャを回すことを考えると、この差は大きい。

3. 4K対応

YouTubeに上げるなら最低1080p、できれば4K。

Klingは4Kに対応しているので、後工程での解像度不足に悩まない。

次点はVeo 3.1。

品質は間違いなくトップクラスで、4枚の参照画像を同時に読み込めるのが面白い。

ただGoogle AI Proの$19.99/月がMV制作の頻度に見合うかは人による。

Runwayは品質だけなら最高峰。

Gen-4.5のキャラクター一貫性は本当にすごい。

でも25cr/秒のコストがネック。

1本のMVを仕上げるのに$50以上飛ぶこともある。

商業クオリティが必要なケース向け。

HigsFieldは複数モデルを横断的に試せるので、「まだどのモデルが自分に合うかわからない」段階では有力。

自分も最初はHigsField経由でKlingとVeoを比較して、Klingに落ち着いた。

画像から動画AI 無料で始めるならこの組み合わせ

お金をかけずに始めたい人向けの組み合わせ。

- 画像生成: Midjourney無料トライアル or Bing Image Creator(DALL-E 3ベース、無料)

- 動画化: Kling AI無料枠 or Google Veo(Flow経由の無料枠)

- 編集: DaVinci Resolve(無料版で十分)

この3つでMV1本作れる。

品質はもちろん有料プランに劣るけど、「自分にMV制作ができるか」を試すには十分だ。

ただし正直に書いておくと、無料枠だけだと生成回数が足りなくて、満足いくクオリティに仕上げるのはかなり厳しい。

自分は「試して感触を掴む→有料に移行」のフローを勧める。

MV1本のためにKling Starter $10/月を1ヶ月だけ課金するのが、一番現実的だと思う。

【実践】画像から動画をAIで生成するMV制作ワークフロー

ここからが本題。

自分がファーストアルバム「Street Festival Symphony」のMV制作で使った実際のワークフローをそのまま書く。

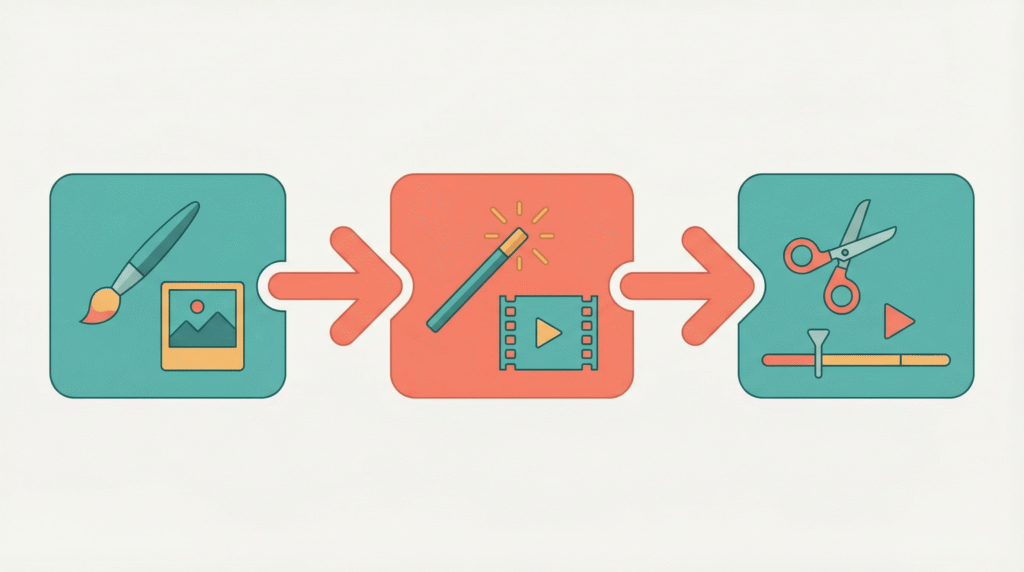

全体の流れ:Midjourney → Kling → DaVinci Resolve

- Midjourney ── 世界観を固める画像を10〜15枚生成

- Kling AI ──── 各画像を5〜10秒の動画に変換

- DaVinci Resolve ── 動画を並べて楽曲とシンク → 書き出し

所要時間の目安は、慣れてくれば1本あたり4〜6時間。

最初の1本は倍かかると思っていい。

Step 1|Midjourneyで世界観を固めるジャケ画・カットを生成

MVの映像は「世界観の一貫性」がすべて。

曲のジャケット画像と、本編で使うカット画像のトーンが揃っていないと、動画にしたときにバラバラになる。

自分のやり方はこう。

まず「世界観プロンプト」を1つ決める。

neon-lit Japanese festival street at night, paper lanterns glowing warm orange,

taiko drums and electronic speakers side by side, cyberpunk matsuri aesthetic,

cinematic lighting, wide angle --ar 16:9 --v 6.1このプロンプトのコア部分(neon-lit Japanese festival、cyberpunk matsuri aesthetic、cinematic lighting)を全カットで使い回す。

シーンごとに変えるのはサブジェクト(被写体)とカメラアングルだけ。

カットリストの例(5曲分のMVから抜粋):

- オープニング: 俯瞰の街並み(wide angle, aerial view)

- Aメロ: 屋台のクローズアップ(close-up, shallow depth of field)

- サビ: 群衆がうねるロングショット(long shot, dynamic movement)

- 間奏: 和楽器のディテール(macro shot, bokeh background)

- アウトロ: 夜明け前の静けさ(dawn light, muted colors)

全部で10〜15枚。

多すぎると編集が大変だし、少なすぎると映像が単調になる。

ポイントはアスペクト比を –ar 16:9で統一すること。

後で動画化するとき、正方形の画像を入れると上下に黒帯が出る。

最初から16:9で作っておく。

Step 2|画像から動画へ——KlingでAI動画生成する手順

Midjourneyの画像が揃ったら、Klingに持っていく。

基本手順:

- Kling AIにログイン → 「Image to Video」を選択

- Midjourneyから保存した画像をアップロード

- モードを選択(後述)

- プロンプトを入力

- 生成を開始(30秒〜2分で完了)

モード選択が最重要。

- Framesモード: 画像の構図・色味を忠実に保つ。ジャケ画をそのまま動かしたいときはこっち

- Elementsモード: 画像を参考にしつつ、動きや構図を自由に変える。ダイナミックなシーンに向く

自分の使い分け。

静かなシーン(間奏、アウトロ)はFrames。

激しいシーン(サビ、ドロップ)はElements。

1本のMV内で混ぜて使う。

Klingのプロンプト例:

Slow camera pan across a neon-lit festival street, paper lanterns swaying

gently in the breeze, warm orange light flickering, crowd silhouettes

moving in the background, cinematic, smooth motionプロンプトの書き方の詳細は次のセクションで掘り下げる。

生成ガチャについて。

1つの画像に対して3〜5回は回す。

同じプロンプトでも生成のたびに結果が変わるので、一番いいものを選ぶ。

MV全体で30〜50回の生成になる。

Kling Starterの$10/月で十分足りる量。

Step 3|DaVinci Resolveで楽曲と映像をシンクさせる

動画素材が揃ったらDaVinci Resolveで編集する。

無料版で全く問題ない。

手順:

- 新規プロジェクトを作成(1080p or 4K、楽曲のフレームレートに合わせる)

- タイムラインに楽曲ファイルをドロップ

- 楽曲の波形を見ながら、セクション(イントロ、Aメロ、サビ等)にマーカーを打つ

- 各マーカーの位置に対応するAI動画クリップを配置

- トランジションを設定

- カラーグレーディングで全体のトーンを統一

ここがポイント:マーカーを先に打つ。

楽曲の構造に合わせてマーカーを打ってから映像を配置する。

映像を先に並べて「なんとなく音を合わせる」やり方だと、サビの入りと映像の切り替わりがズレて、一気に素人感が出る。

マーカーの打ち方は、再生しながら曲を聴いて、ビートの変わり目やセクションの境目で `M` キーを押すだけ。

30秒でできる。

トランジションは控えめに。

クロスディゾルブ(フェード)を基本にして、カット切り替えを混ぜる程度。

ワイプやスピンみたいな派手なトランジションは安っぽく見える。

カラーグレーディングも軽くていい。

AI動画は素材ごとに色味が微妙に違う。

DaVinci Resolveのカラーページで、全クリップの色温度とコントラストをざっくり揃えるだけで統一感が出る。

ガチのカラリストみたいなことをする必要はない。

Step 4|書き出しとYouTubeアップロード設定

書き出し設定:

| 項目 | 推奨値 |

|---|---|

| フォーマット | MP4 (H.264) |

| 解像度 | 1080p or 4K |

| フレームレート | 30fps |

| ビットレート | 15〜20 Mbps(1080p)/ 50〜80 Mbps(4K) |

YouTubeは再エンコードでかなり画質が落ちるので、元素材は高めのビットレートで書き出す。

YouTubeの設定で忘れがちなこと:

- タイトルに「Official Music Video」を入れる(検索で有利)

- 説明文に楽曲情報(曲名、アルバム名、ストリーミングリンク)を入れる

- タグにアーティスト名 + ジャンル + 「AI MV」を入れる

- サムネイルはMidjourneyのジャケ画をそのまま使える

MVの公開後にAI音楽で収益化する方法も参考にしてほしい。

YouTubeの広告収益やストリーミング配信まで含めた収益化の流れをまとめてある。

画像から動画AIプロンプトの書き方|動きの質を上げるコツ

ツールの使い方がわかっても、プロンプト次第で出力のクオリティは天と地ほど変わる。

ここではKlingを前提に、動画プロンプトの書き方を掘り下げる。

Klingプロンプトの基本構文と実例

動画プロンプトには画像プロンプトと違う「動き」の要素が入る。

基本構文はこう。

[カメラワーク], [被写体の動き], [環境・雰囲気], [ライティング], [品質指定]実例1:静かなシーン(間奏向け)

Slow dolly forward through a misty temple garden at dawn, stone lanterns

lining the path, cherry blossom petals drifting slowly downward, soft

golden light filtering through trees, cinematic, 4K, smooth motion実例2:激しいシーン(サビ向け)

Dynamic handheld camera pushing through a crowded neon festival, taiko

drummers performing intensely, sparks flying from fireworks above,

rapid light changes, energetic, cinematic motion blur実例3:ディテールショット(Bメロ向け)

Extreme close-up of shamisen strings vibrating, shallow depth of field,

warm amber backlight, subtle camera rack focus to blurred lanterns

in background, intimate, atmospheric要素を全部入れようとして長文になりすぎるとKlingが混乱する。

1プロンプト50語前後がスイートスポット。

自分は40〜60語の範囲に収めている。

避けるべきNG表現と失敗パターン

何十回も生成ガチャを回して学んだNG集。

NG1:抽象的な動きの指示

❌ beautiful movement flowing gracefully

✅ slow left-to-right camera pan, 3 seconds「beautiful」「graceful」みたいな形容詞はAIにとってノイズ。

具体的な動きの方向と速度を書く。

NG2:複数の被写体に同時に違う動きを指定

❌ dancer spinning while camera zooms out and birds fly across the sky

✅ dancer spinning in center frame, slow zoom out1プロンプトにつき主要な動きは1〜2つまで。

3つ以上入れると全部中途半端になる。

NG3:ネガティブプロンプトの省略

Klingのネガティブプロンプト欄に以下を常に入れておく。

deformed, glitch, artifacts, low quality, blurry, watermark, text overlayこれだけで生成ガチャの打率が体感20%上がる。

地味だけど効果がでかい。

カメラワーク指定で映像にプロ感を出す

AI動画のプロンプトで一番差がつくのがカメラワーク。

これを指定しないと「固定カメラでなんとなく動いてる映像」になりがち。

よく使うカメラワーク用語:

| 用語 | 動き | 使いどころ |

|---|---|---|

| dolly forward/back | カメラが前後に移動 | オープニング、場面転換 |

| pan left/right | カメラが左右に回転 | 風景、街並みの全景 |

| tilt up/down | カメラが上下に回転 | 建物を見上げる、空から地上へ |

| tracking shot | 被写体を追従 | キャラクターの移動シーン |

| crane shot | 高い位置から俯瞰 | サビの入り、クライマックス |

| handheld | 手持ち風の揺れ | ライブ感、臨場感 |

| rack focus | ピント移動 | 前景→背景の注目移動 |

| slow zoom | ゆっくりズーム | 感情的なシーン、アウトロ |

MVでは「サビでcrane shot、Aメロでslow dolly、間奏でrack focus」みたいに楽曲の強弱とカメラワークを対応させると映像に抑揚が出る。

自分のStreet Festival SymphonyのMVでは、和太鼓が入るセクションでhandheld+dynamic tracking、尺八のソロではslow dolly+rack focusを使い分けた。

曲のエネルギーとカメラの動きが合うと、それだけで「プロっぽい」映像になる。

AI動画生成を画像から行うときの注意点とトラブル対策

生成ガチャを減らす画像の前処理

Klingに画像を投げる前に、ちょっとした前処理をするだけで生成の打率が変わる。

解像度は最低2048px幅。

低解像度の画像を入れると、Kling側でアップスケールする際にアーティファクトが出やすい。

Midjourneyで `–q 2` をつけて高品質で出力しておくといい。

余白に注意。画像の端に重要な要素があると、動画化の際に切れることがある。

被写体は中央〜中央やや上に配置する。

構図の段階で意識しておくと後が楽。

コントラストが極端な画像は避ける。

真っ黒な背景に真っ白な被写体、みたいな画像は動きの生成が不安定になりやすい。

中間調がある画像のほうが安定する。

尺が足りないときの対処法

1曲3〜5分のMVに対して、AI動画は1クリップ5〜10秒。

単純計算で20〜60クリップ必要になる。

全部を新規生成すると時間もコストもかかる。

対策はいくつかある。

同じクリップのスロー化。

DaVinci Resolveの「リタイム」で50%スローにすると、5秒のクリップが10秒になる。

AI動画は元がぬるっとした動きなので、スローにしても不自然さが出にくい。

リバース再生。

クリップを逆再生して、元の映像→逆再生→元の映像とループさせる。

1クリップで3倍の尺を稼げる。

間奏やアウトロの「繰り返し感」と相性がいい。

静止画パン(Ken Burns効果)。

動画化がうまくいかなかった画像は、静止画のまま拡大+パンで使う。

DaVinci Resolveのキーフレームで簡単にできる。

全カットをAI動画にする必要はない。

混ぜたほうがむしろ映像にメリハリが出る。

著作権まわりで知っておくべきこと

2026年3月時点の状況を整理する。

法律の専門家ではないので、あくまで自分が調べた範囲での理解。

AI生成動画の著作権。

日本の現行法では、AIが自律的に生成したコンテンツに著作権は発生しないとされている。

ただし、プロンプト設計や編集に「創作的寄与」があれば、その部分に著作権が認められる可能性がある。

MVの場合、楽曲選択、カット構成、編集、カラーグレーディングなど人間の判断が多く介在するので、完全に「著作権なし」とは言い切れない。

各ツールの利用規約。

Kling、Veoなど主要ツールは有料プランであれば商用利用OKとしている。

無料プランは個人利用限定のものが多い。

MVをYouTubeに上げて広告収益を得るなら、有料プランの利用を推奨する。

楽曲側の権利。

Sunoで曲を作る完全ガイドでも触れたけど、Sunoは有料プランなら楽曲の商用利用が可能。

楽曲と映像の両方で商用利用OKのプランを使っていれば、YouTube公開は問題ない。

気になる人は各ツールの最新の利用規約を直接確認してほしい。

この分野は法整備が進行中で、半年後には状況が変わっている可能性がある。

AI音楽×AI映像——ひとりで完結するMV制作の未来

楽器が弾けなくてもMVが作れる時代

1年前を振り返ると信じられない速度で進化している。

自分がAI音楽を始めたのは2025年。

そのときは「AIで曲が作れる」だけで十分すごかった。

2026年に入って、それに「AIで映像も作れる」が加わった。

楽器が弾けない。

映像の学校も出ていない。

でもMVが作れる。

「誰でもプロになれる」とは思わない。

ツールが使えることと、いい作品を作れることは別の話だ。

でも「道具がないから始められない」という障壁はほぼゼロになった。

AI音楽にオリジナリティを出す5つの方法でも書いたけど、AIツールは「平均的なもの」を出すのは得意で、「個性的なもの」を出すのは苦手。

音楽も映像も、最終的にはプロンプト設計や素材選び、編集で「自分の色」を出していくしかない。

ツールが進化しても、そこは変わらないと思う。

制作コストのリアル:実際にいくらかかったか

Street Festival SymphonyのMV制作にかかった費用を公開する。

| 項目 | 月額 | 用途 |

|---|---|---|

| Midjourney Standard | $30/月 | 画像生成(ジャケ画+カット) |

| Kling AI Starter | $10/月 | 動画生成 |

| DaVinci Resolve | $0 | 編集(無料版) |

| 合計 | $40/月 |

日本円で約6,000円/月。

1ヶ月でMV2〜3本作れるから、1本あたり2,000〜3,000円。

もちろんこれに自分の作業時間は含まれていない。

でも外注でMVを作ったら最低でも5〜10万円はかかる。

しかも自分の頭の中のイメージを他人に伝えるコミュニケーションコストがゼロなのが大きい。

「自分の曲のMVを、自分のイメージ通りに、6,000円で作れる」。

1年前には考えられなかった。

個人でMVまで完結できる環境が、もう普通に手に入る。

楽曲制作側のコストについてはSunoスタイルタグ逆引き辞典の冒頭でも触れているので参考にしてほしい。

次のステップ:ライブ映像やリリックビデオへの応用

画像→動画のワークフローに慣れたら、次に広がる方向はいくつかある。

リリックビデオ。

歌詞をMidjourney画像に焼き込んでから動画化する方法と、DaVinci Resolveで後からテキストを重ねる方法がある。

後者のほうが柔軟。フォントやタイミングを自由にコントロールできる。

ライブ映像風MV。

HigsFieldやKlingのElements/Motionモードを使うと、カメラの揺れやステージライティングを再現したライブ風映像が作れる。「架空のライブ」のMVを作るのもAIならではのアプローチ。

ショート動画。

YouTube ShortsやTikTok用に、MVから15〜60秒を切り出す。

フルMVより先にショートを公開して、フルバージョンへの導線にする戦略もある。

どこまでやるかは人それぞれ。

でも「画像→動画」のワークフローが身につけば、応用はいくらでもきく。

まずは1本作ってみてほしい。

MVを1本完成させたときの達成感は、正直めちゃくちゃある。

DJ Albatross — 和楽器×エレクトロニカ。楽器弾けないけど音楽作ってる。