Sunoで初めて曲を作ったとき、正直テンション上がった。

プロンプト数行で、それなりに聴ける曲が出てくる。

すごい時代だ。

でも3曲、5曲と作っていくうちに気づく。

「あれ、全部同じに聞こえないか?」

これ、AI音楽をやってる人ならほぼ全員通る道だと思う。

いわゆる「ジェネリック問題」。

AIが学習データの平均値を出力するから、何を作っても「どこかで聴いたことある、当たり障りのない曲」になる。

2026年に入ってSuno v5やGoogleのLyria 3が出て生成品質は上がったけど、この問題は本質的に変わっていない。

自分もそうだった。

最初の数曲は「おお、すごい」で終わった。

でもファーストアルバム「Street Festival Symphony」を作るまでに試行錯誤して、「個性の出し方」がだいぶ見えてきた。

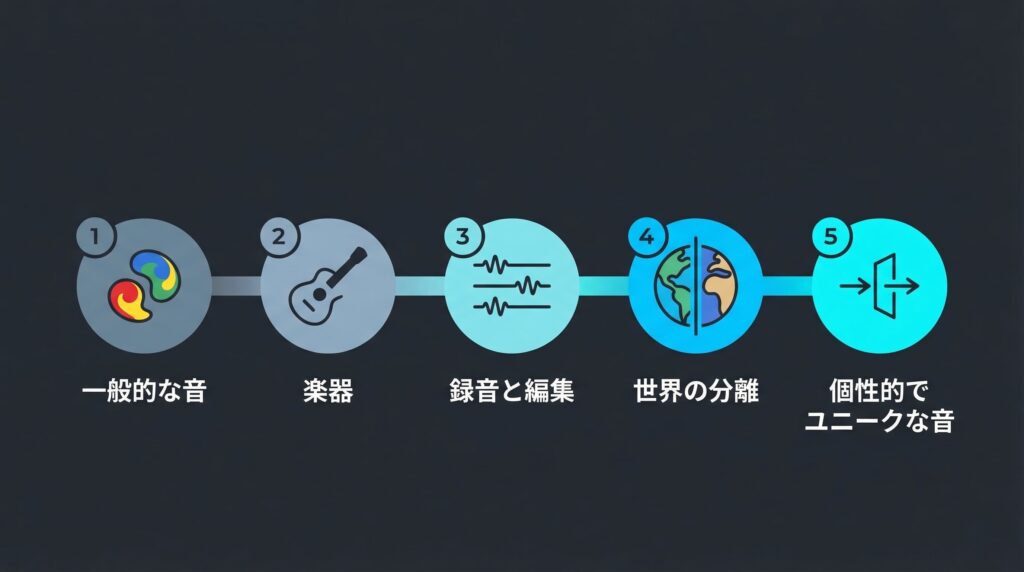

この記事では、自分が実際にやっている5つの方法をまとめる。

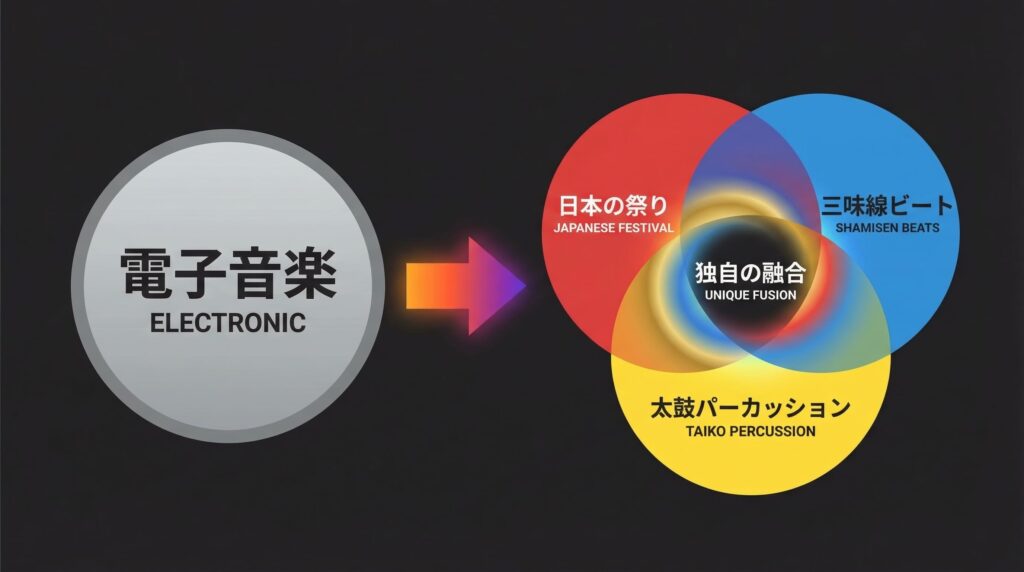

1. スタイルタグを「混ぜる」

一番手っ取り早い。

そして効果がでかい。

Sunoで曲を作るとき、スタイル欄に「Pop」とか「Rock」とか1ジャンルだけ入れてないだろうか。

それだと「そのジャンルの平均的な曲」が出てくる。

当然だ。

やるべきはジャンルの掛け合わせ。

Before:

Style: ElectronicAfter:

Style: Japanese Festival Electronic, Shamisen Beats, Taiko Percussion, Neon Matsuri Vibesこの差はでかい。

単一ジャンルだと「よくあるエレクトロニカ」が出るけど、複数のスタイルタグを組み合わせると、AIは「このジャンルとこのジャンルの中間」を探す。

その中間地点が、あなただけの音になる。

自分の場合、和楽器×エレクトロニカという組み合わせにたどり着くまでに20曲くらい捨てた。

でもハマったときは「これだ」って感覚がある。

スタイルタグの全リストはスタイルタグ辞典にまとめてあるので、組み合わせの参考にしてほしい。

2. 楽器を具体的に指定する

「guitar」と書くのと「traditional Japanese shamisen」と書くのでは、出力がまったく違う。

これ、最初は気づかなかった。

Yozakura Mixの制作中、和のテイストを出したくて「shamisen」とだけ入れたんだけど、出てくる音がなんか中途半端。

アジアっぽいけど、日本っぽくはない。

「traditional Japanese shamisen」に変えた瞬間、音の質感が変わった。マジで変わった。

Before:

Style: Electronic, shamisenAfter:

Style: Japanese Festival Electronic, traditional Japanese shamisen, shakuhachi flute, wadaiko drumsポイントは3つ。

- 修飾語をつける — 「shamisen」→「traditional Japanese shamisen」

- 複数の楽器を組み合わせる — 三線だけじゃなく、尺八と和太鼓もセットで入れると「和楽器アンサンブル」としてAIが認識する

- 一般名ではなく固有名を使う — 「flute」ではなく「shakuhachi flute」、「drums」ではなく「wadaiko drums」

楽器の具体名が増えるほど、AIの出力は「平均」から離れていく。

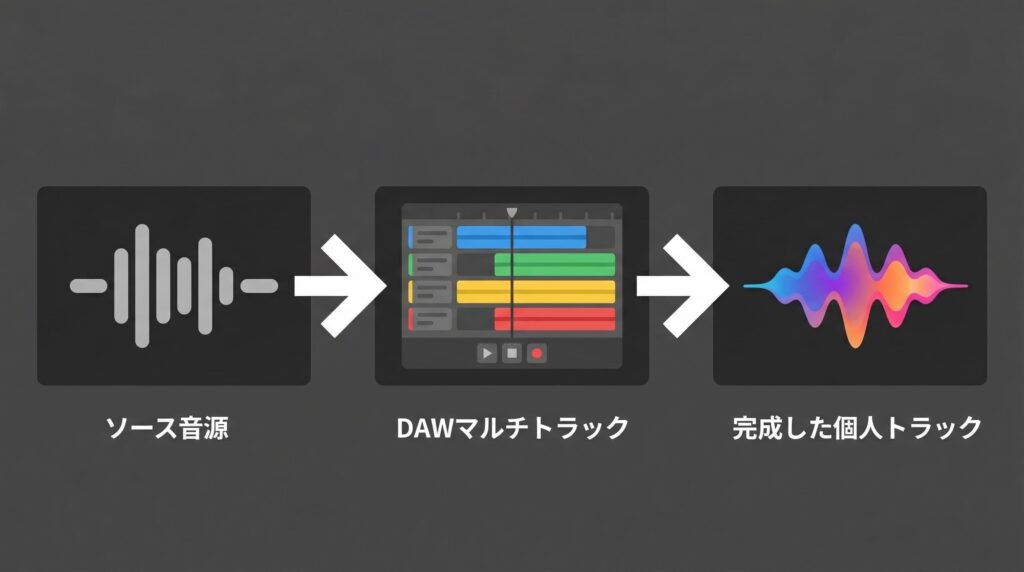

3. DAWで手を加える

ここが一番大事かもしれない。

Sunoの出力をそのまま公開してる人、結構多い。

気持ちはわかる。

生成された時点でそれなりに聴けるから、「これでいいか」となる。

でもそれが「全部同じに聞こえる」原因の一つ。

Sunoのミキシングやマスタリングには癖がある。

同じエンジンで処理してるんだから当然だ。

自分はAbleton Live 12で必ず手を加える。

やること:

- ステム分離 — ボーカル、ドラム、ベース、その他を分離する(Lalal.aiやDemucsを使う)

- EQ・コンプの調整 — Sunoの出力は中域が詰まりがちなので、整理する

- パートの追加 — 生成されなかった楽器を自分で足す。シンセパッドを重ねるだけでも変わる

- 構成の変更 — イントロが長すぎたら切る。ブリッジを追加する。Sunoの提案する構成が最適とは限らない

Street Festival Symphonyの全曲は、Sunoで生成→Abletonで再構築という流れで作った。

生成段階では60点の素材が、DAWを通すと自分の曲になる。

Sunoの基本的な使い方を押さえた上で、DAWでの後処理を前提にワークフローを組むのがおすすめ。

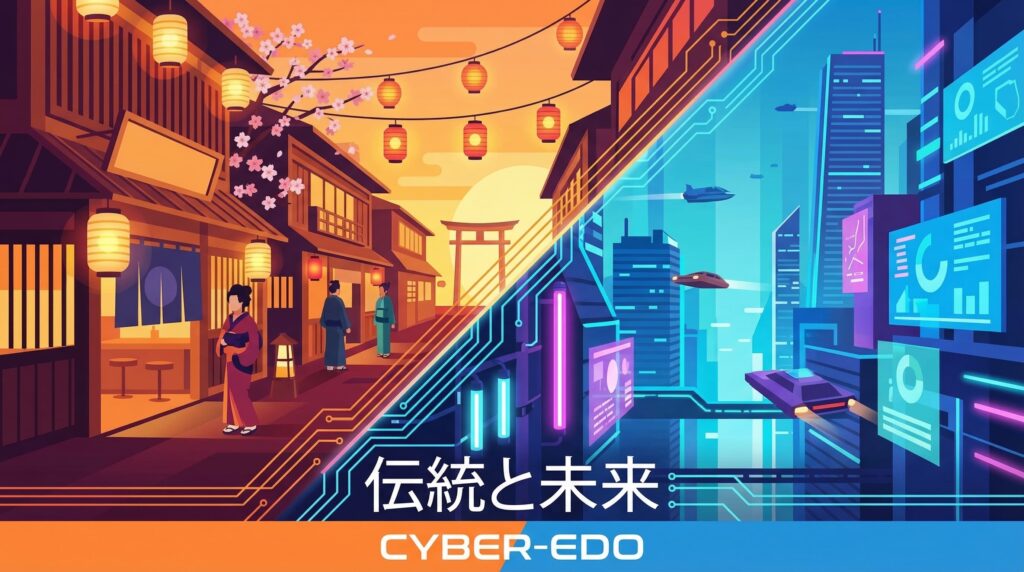

4. 世界観を先に作る

プロンプトを書く前にやることがある。

コンセプト設計だ。

「かっこいい曲作りたい」でSunoを開くと、たいてい迷子になる。

何を作りたいのか自分でもわかってないから、プロンプトが曖昧になる。

曖昧なプロンプト = ジェネリックな出力。

自分の場合、Neo Edo Festivalというコンセプトを先に作った。

「江戸時代の祭りが、サイバーパンクの未来都市で開催されている」

この一行があるだけで、プロンプトの方向性が決まる。

Before(コンセプトなし):

Style: Japanese Electronic

Lyrics: A song about a festivalAfter(コンセプトあり):

Style: Neo Edo Cyberpunk Festival, Japanese Festival Electronic, Shamisen Beats, Taiko Percussion, Synthwave, Neon Matsuri

Lyrics: [Verse] Neon lanterns float above the crowd / Digital shamisen playing loud...世界観があると、楽器選び、テンポ、歌詞の方向性が自動的に絞られる。

迷いが減るし、アルバム単位で一貫性が出る。

これはAI音楽を始めた理由にも書いたけど、音楽は「音」だけじゃない。

世界観、ストーリー、ビジュアル、全部セットで設計するものだと思う。

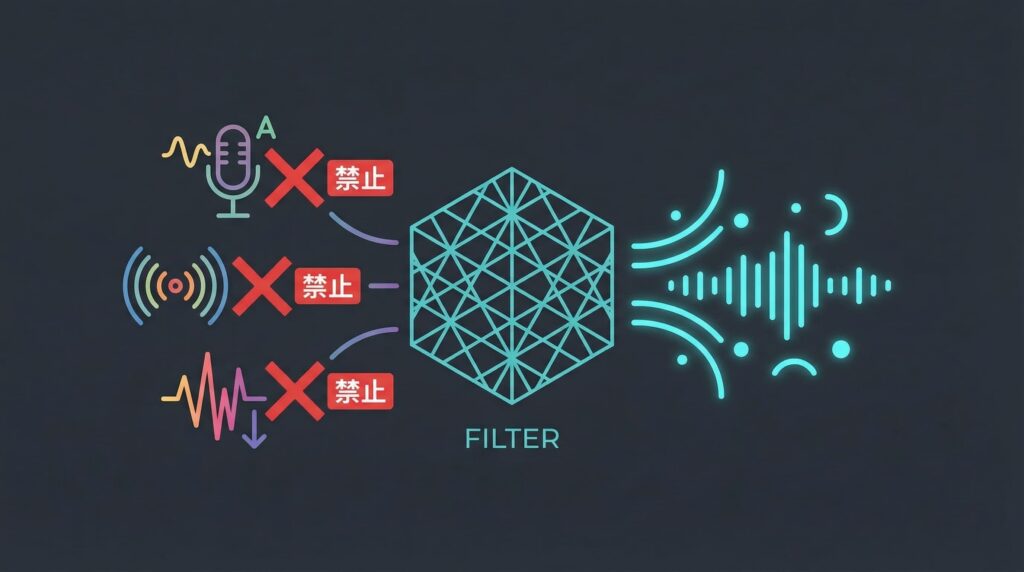

5. ネガティブプロンプトで「普通」を排除する

Suno v5から、スタイル欄に「入れたくない要素」を指定できるようになった。

これがかなり効く。

AI音楽が「AI音楽っぽく」聞こえる原因は、いくつかの共通要素がある。

- 過度なオートチューン

- 深すぎるリバーブ

- テンプレ的なドロップ

- 均一すぎるダイナミクス

これらを明示的に排除する。

Before:

Style: Electronic PopAfter:

Style: Electronic Pop, raw vocals, dry mix, organic percussion

No: autotune, heavy reverb, EDM drop, compressed dynamics「何を入れるか」だけじゃなく「何を入れないか」を決めるのが大事。

ネガティブプロンプトで「よくあるAI音楽」の特徴を消すと、残った部分に個性が浮かび上がる。

画像生成AIでネガティブプロンプトが重要なのと同じ理屈だ。

まとめ

5つの方法を整理する。

| 方法 | 一言で言うと |

|---|---|

| #1 スタイルタグを混ぜる | ジャンルの掛け合わせで「平均」から離れる |

| #2 楽器を具体的に指定する | 「guitar」じゃなく「traditional Japanese shamisen」 |

| #3 DAWで手を加える | Sunoの出力はあくまで素材 |

| #4 世界観を先に作る | プロンプトの前にコンセプトを設計する |

| #5 ネガティブプロンプト | 「普通」を明示的に排除する |

1と2はプロンプトの工夫で今すぐできる。

3はDAWの知識が要るけど、ステム分離してEQいじるだけでも変わる。

4と5は考え方の話で、意識するだけで出力が変わる。

全部やる必要はない。1つでもいい。「どこかで聴いた曲」から「自分の曲」になる瞬間は、わりとあっさり来る。

DJ Albatross の最新作はYouTubeで公開中。チャンネル登録もぜひ。