音楽は、ずっと「向こう側」の世界だった

ずっと憧れだった音楽制作。

正直に言うと、自分が音楽を作れるようになるとは考えたこともなかった。

仕事はWeb制作。かれこれ長いことやっている。

デザインして、コード書いて、サイトを組む。

「作る」という行為自体には慣れているほうだと思う。

でも音楽は完全に別世界。

ギターのコードひとつ知らない。

楽譜も読めない。

DTMという言葉は知っていたけど、DAWの画面を見ても「これは自分の来る場所じゃないな」と思って閉じた。

そんな経験、一度や二度じゃない。

音楽が好きじゃなかったわけじゃない。

むしろ好きだった。

Spotifyのプレイリストにはこだわりもある。

ただ、「聴く側」と「作る側」の間には、とんでもなく深い溝があるように見えていた。

才能、知識、経験、機材。どれも持っていない自分には、越えられる気がしなかった。

AI音楽との出会い ― Sunoで景色が変わった

2024年の夏、Sunoというサービスを見つけた。

テキストでプロンプトを書くと、AIが曲を生成してくれる。

最初は「まあ、おもちゃみたいなものだろう」くらいに思っていた。

実際に生成された曲を聴いて、その認識は完全にひっくり返った。

普通に、聴ける。

もちろん粗さはある。

でも「楽器が弾けない人間が5分前に作った音楽」として考えると、ちょっと信じられないクオリティだった。

それまで「音楽を作る」というのは、楽器を練習して、音楽理論を学んで、DAWの操作を覚えて――という長い階段の先にあるものだった。

その階段が、いきなり数段になった感覚。

ゼロにはなっていない。

でも「登ってみようかな」と思える高さにはなった。

試してみたら、思ったより楽しい

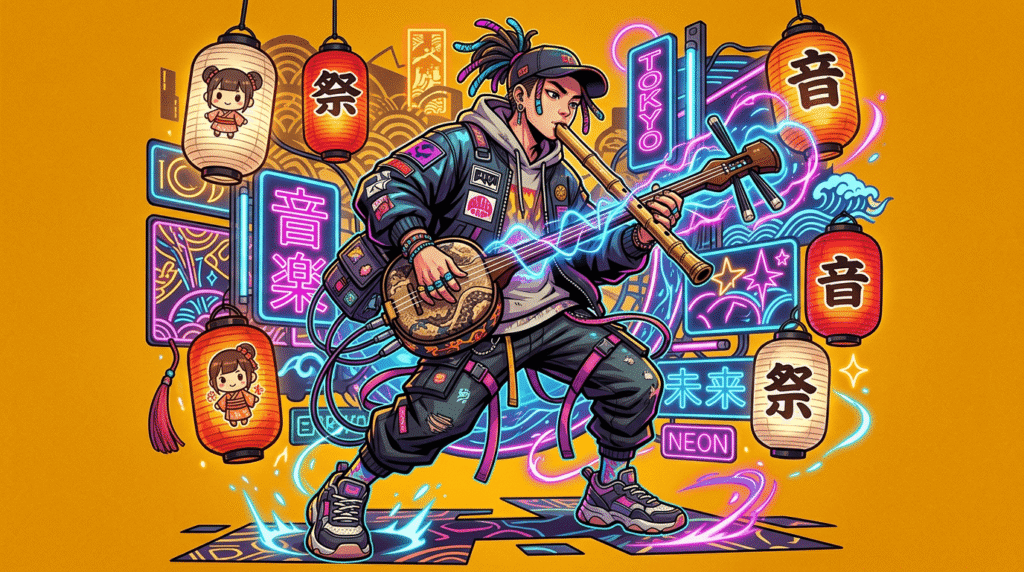

最初にSunoで作ったのは、和楽器っぽいエレクトロニカ。

三線の音色とシンセが混ざったような曲。

なぜそのジャンルだったのかと聞かれると、単純に「聴きたかったから」かな。

自分が聴きたい音楽を、自分で作れる。

この感覚が思った以上に強烈だった。

そこからは早い。

プロンプトの書き方を変えて、尺八の音を混ぜてみたり、和太鼓のリズムを加えてみたり。

「江戸時代のサイバーパンク」みたいな世界観が頭の中に浮かんで、それをそのまま音にしてみた。

Neo Edo Festivalと名付けたその世界は、今の活動の核になっている。

Sunoだけで完結するわけじゃない。

生成された音源をAbleton Live 12に取り込んで、構成を整えたり、ミキシングを調整したりする工程が出てくる。

映像をつけたいと思ったらMidjourneyで画を作って、DaVinci Resolveで編集する。

ひとつのAIツールで完結するんじゃなく、いくつものツールを組み合わせて、自分の頭の中にあるイメージに近づけていく。

これ、Web制作と似てるなと思った。

素材を集めて、構成を考えて、ひとつの形にまとめる。

使うツールが違うだけで、やっていることの本質は近い。

「AI音楽はお前が作ってるわけじゃない」と言われたら

ここまで読んで「それはAIが作ってるだけだろ」と思う人もいると思う。

正直、その気持ちはわかる。自分でも最初はそう思った。

でも実際にやってみると、AIはあくまで「出発点」なんだと気づく。

Sunoが出してきた曲をそのまま出すことはほぼない。

テンポを変えたり、構成を入れ替えたり、別の楽器パートを足したり。

何十回もリジェネして、「これだ」と思える1曲を選ぶ。

その選ぶ行為自体が、もう表現になっている。

音楽は「作れる人の世界」だと思っていた。

理論を知っている人、楽器を弾ける人、幼い頃から音楽に触れてきた人。

そういう人たちだけが入れる場所だと。

AIが変えたのは、その入口の広さだ。

「作れる」まではいかなくても、「試せる」にはなった。

試して、聴いて、「違うな」と思ったら変えて、また試す。

そのサイクルを回せるようになった。

才能がなくても、理論を知らなくても、「やってみようかな」と思えたらそこがスタートライン。

だから、AI時代に音楽活動を始めた

試しているうちに、曲が溜まってきた。

10曲、20曲と作っていくうちに「これ、ちゃんとリリースしてみたいな」と思うようになった。

DistroKitを使って、SpotifyやApple Musicに配信した。

DJ Albatrossという名前で。

自分の作った曲がストリーミングサービスに並んでいるのを見たとき、初めて作ったWebサイトが公開されたときの感覚に近かった。

派手な感動じゃない。

「あ、本当にできるんだ」という、静かな驚き。

YouTubeにも手を広げた。

Music Filmと呼んでいるシリーズでは、AIで生成した映像と音楽を組み合わせて、ひとつの世界観を作っている。

「Street Festival Symphony」は祭囃子とエレクトロニカが交差する映像作品だし、「Firefly Canal」は蛍が飛ぶ水路のアンビエント。

どちらも自分の頭の中にあったイメージを形にしたもの。

活動を始めて気づいたのは、「完璧じゃなくていい」ということ。

プロのミュージシャンと比べたら技術は足りない。

でも、自分にしか作れない組み合わせがあるかもしれない。

和楽器とエレクトロニカ、江戸とサイバーパンク、実写とAI映像。

その掛け合わせは、自分の中にある好奇心から生まれたもので、誰かの真似じゃない。

AI音楽を始めた理由は「やってみようかな」だけだった

この記事を読んでくれている人の中にも、「何か作ってみたいけど、自分には無理だ」と思っている人がいるかもしれない。

少し前の自分がまさにそうだった。

楽器は弾けないし、音楽理論も知らない。

でもSunoを触ってみたら、「試す」ことはできた。

試しているうちに楽しくなって、楽しいから続けて、気づいたらアルバムをリリースしていた。

必要だったのは才能でも知識でもなく、「やってみようかな」という、たったそれだけの気持ち。

AIは人間の表現を奪うものだという議論がある。

でも自分みたいに、AIがなかったら一生表現を始めなかった人間もいる。

奪うんじゃなくて、入口を増やしてくれた。少なくとも自分にとってはそうだった。

DJ Albatrossの楽曲やMusic Filmは、YouTubeチャンネルで公開している。

和楽器 × エレクトロニカ、江戸 × サイバーパンクの世界を覗いてみてほしい。